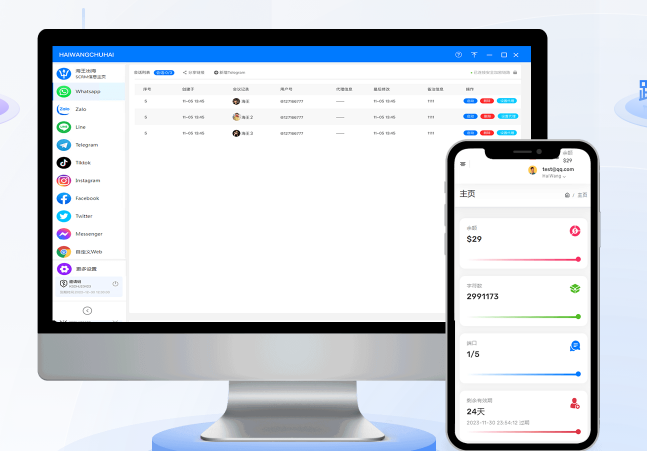

海王出海通过把来自不同社交渠道的粉丝按“能唯一识别的字段”先做精确匹配,再用若干可配置的组合规则做模糊比对,标记重复并合并成主记录;系统既支持实时同步去重,也支持批量清洗与人工复核,最终在去重报表里给出重复条数、重复率、来源分布及合并日志,便于运营追溯与下一步动作。

先说结论(用很简单的话)

想像你把很多张名片堆到桌子上:有的人换了头像,但手机号一样;有的人在不同平台使用同一邮箱;还有人只是在名称前后多了个空格。海王出海的去重,就是把这些名片先按“最能证明是同一个人”的信息(如社交平台唯一ID、手机号、邮箱)对齐,找不到精确匹配的再用组合规则(姓名+国家、昵称模糊匹配等)比对,打上“重复”标签后按规则合并或放进人工待复核队列,统计并输出报表。

为什么要这样做(理解原理)

费曼写法:要是你要把知识传给别人,先把概念化成最容易理解的几个步骤。同理,去重的核心不是把所有行都智能合并,而是把事情拆成“识别→决策→执行→记录”四步:

- 识别:找出可能是同一个人的记录对。

- 决策:判断是否重复,以及用哪个记录为主。

- 执行:合并、保留、或标记为不同对象。

- 记录:保存来源、合并日志,便于回溯。

识别的关键:哪些字段最有“证明力”

不同字段的可信度不同,通常优先级如下(从高到低):

- 社交账号的唯一ID(平台原生ID)——几乎能唯一标识一个账号。

- 手机号——在跨平台场景里非常有用,但可能被复用或更换。

- 邮箱——对B2B和职业账号尤其有效。

- 国家/地区+姓名/昵称的组合——需要做模糊/相似度判断。

- 设备ID、会话ID、IP等辅助信息——用于边界判断。

海王出海的去重流程(一步步操作视角)

下面按用户在平台上常见的流程描述,既有自动化也有人工参与环节,写得像在旁边做操作说明那样:

1) 数据来源汇总与标签化

首先,平台把所有接入的社交渠道(如Facebook、Instagram、WhatsApp、TikTok、邮件订阅等)同步到统一的“粉丝/客户池”。每条记录会带上来源标签(channel)、时间戳、原始平台ID。标记很重要——合并后你还能知道这条资料最初来自哪里。

2) 精确规则优先匹配

系统先跑一遍“精确匹配”:有社交平台唯一ID则直接判同;若没有ID则看手机号或邮箱,能完全相同的直接标记为重复,并进入自动合并或待合并队列(取决于设置)。

3) 组合规则与模糊匹配

精确匹配之外,平台会用组合字段(如姓名+国家、昵称相似度+活跃时间重叠等)做相似度计算。相似度阈值是可配置的:高阈值只找非常像的,低阈值会多抓一些疑似重复但需要人工判断的记录。

4) 合并策略与优先级规则

合并时要决定哪条记录做主数据。常见策略包括:

- 最新活动优先:保留最近有互动的一条为主。

- 来源优先:按渠道可信度排序(例如官网表单>邮件订阅>社媒私信)。

- 字段完整度优先:包含更多联系信息的记录优先。

- 人工指定:保留标注的主记录。

5) 人工复核与机器学习辅助

对于相似度处在阈值边缘的对,系统会把它们推到人工复核队列。复核时,运营可以查看两条记录的对比、历史对话和来源日志,然后选择“合并/不合并/保持待观察”。一部分平台还会把复核结果反馈给模型,以逐步优化模糊匹配的准确率。

6) 日志与可追溯性

每一次自动合并或人工操作都会产生合并日志(谁、什么时候、依据哪个规则、保留了哪些字段、丢弃了哪些字段)。这是检验去重质量和排查问题的关键。

去重结果如何以统计的形式呈现

去重不只是把数据合起来,关键是把结果变成可用的指标,常见的统计项包括:

- 重复总条数(被判为重复且已合并的记录数)。

- 重复率(重复条数 / 总粉丝数)。

- 按渠道分布的重复(哪个渠道产生了最多重复)。

- 按时间段的重复趋势(何时导入/活动产生高重复)。

- 待人工复核数量与通过率。

| 指标 | 说明 |

| 重复条数 | 系统判定并合并的记录数,含自动与人工合并。 |

| 重复率 | 重复条数 ÷ 导入/同步的总记录数。 |

| 渠道重复分布 | 按来源渠道统计重复发生的比例,帮助找数据质量源头。 |

| 人工复核通过率 | 被推送复核的记录中,最终被合并的比例。 |

常见场景示例(帮助理解)

举几个场景,边想边写,你会更容易明白:

场景A:同一手机号,两个社媒账号

规则:手机号精确匹配→自动标为重复。合并策略:保留有更多历史消息的账号记录为主,保留两个账号的来源标签。

场景B:不同手机号,但姓名+国家+邮箱相同

规则:邮箱精确匹配优先;若邮箱缺失,则姓名+国家+最近活跃时间相近作为高相似度候选,需要人工复核。

场景C:昵称相似但无其他交叉信息

规则:走模糊匹配,低阈值可能把一些不同人误判为重复,因此通常会推到人工队列。

设置建议与最佳实践

实操中我会建议按下面的步骤来配置和运维,能最大化准确性又不丢信息:

- 优先启用平台ID、手机号、邮箱的精确匹配,把简单的重复先清掉。

- 设置保守的模糊匹配阈值,把模糊结果推到人工复核,避免误合并。

- 保留合并日志与原始来源字段,便于回溯和审计。

- 定期做批量清洗(如每周/每月),并把清洗前后的数据快照保存一段时间。

- 把去重统计纳入KPI或数据看板,比如重复率下降是数据质量改善的指标。

常见问题与排错思路

在实际使用中会遇到一些常见疑问,这里顺手列出并给出处理方法:

- 为什么系统没把明显重复的合并? 检查规则优先级和相似度阈值,或确认字段(如手机号)是否被平台正确识别为同一格式。

- 合并后丢失了重要的私信记录怎么办? 合并策略应该配置为“合并消息历史而非覆盖”,合并日志可用于恢复。

- 重复率突然攀升: 检查近期的导入渠道和活动,常见原因是一次性导入了多来源的客户名单或营销活动触发了重复关注。

权限、隐私与合规考量

去重过程中会处理手机号、邮箱和消息记录等敏感信息,务必注意:

- 保证只有有权限的角色能执行合并/复核操作并查看敏感字段。

- 合并前保留原始数据快照,合并后保留来源与日志,以满足合规审计。

- 跨国数据处理要遵守目标国家的隐私法规(如GDPR、CCPA等)。

如果你要把这个流程落地(操作checklist)

- 确认平台同步的渠道与字段清单(ID、手机号、邮箱、国家、昵称等)。

- 配置精确匹配优先的规则。

- 定义模糊匹配的阈值与人工复核流程。

- 选定合并策略(最新/完整/来源优先)。

- 开启合并日志与去重报表,并定期检查重复率趋势。

写到这里,顺便提醒一句:去重不是一次性“修好”就结束的事,它更像是持续的数据保养——规则要跟业务和渠道变化同步调整。海王出海把这些常见机制都做成了可配置的模块(如同步去重、批量清洗、人工复核、合并日志与报表),你只需要按上面的清单逐项检查和配置,就能把重复粉丝问题控制住,让运营数据更干净,客户沟通更精准。